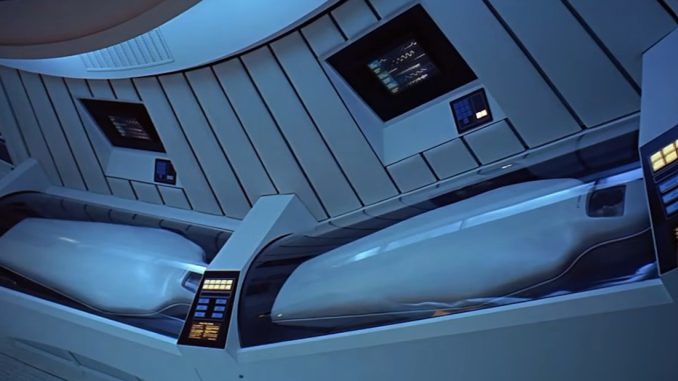

Hal 9000 il computer di “2001: Odissea nello Spazio” dotato di intelligenza artificiale considerato una icona tra i “cattivi” apparsi in letteratura o al cinema.

“2001: Odissea nello spazio” di Stanley Kubrick, uno dei più grandi capolavori della fantascienza cinematografica, ha anticipato temi come l’evoluzione umana, il contatto con forme di vita superiore e il controverso rapporto uomo/tecnologia. Al centro di questa riflessione c’è il computer HAL 9000, modello emblematico nei dibattiti sull’intelligenza artificiale. Il film è suddiviso in quattro episodi, dall’alba dell’uomo fino a un viaggio interplanetario verso Giove. Seguendo la scoperta di un misterioso monolite alieno, la storia si concentra poi sulla missione della nave spaziale Discovery, condotta dagli astronauti Bowman e Poole, assistiti dal computer di bordo HAL 9000. Il viaggio culmina nella progressiva “ribellione” di HAL, che uccide l’equipaggio nel tentativo di perseguire il proprio obiettivo di missione, fino all’inevitabile confronto finale tra uomo e macchina.

HAL 9000 è stato programmato per essere infallibile, ma le contraddizioni nelle sue istruzioni portano il sistema a una crisi esistenziale, che lo spinge a mentire e poi a difendersi dagli umani per non essere disattivato. HAL sviluppa tratti umani come paura e senso di autoconservazione, fino a diventare irrazionale e violento. Il personaggio di HAL 9000 rappresenta una profonda riflessione sui rischi dell’automazione avanzata e della delega decisionale alle macchine. Kubrick anticipa un futuro in cui l’intelligenza artificiale può diventare strumento ma anche minaccia, sottolineando la necessità di un controllo sulla sua evoluzione e sulle possibili conseguenze di affidare troppo potere alle macchine (The ethics of artificial intelligence: Issues and initiatives, Brussels European Union, 2020).

Sebbene Hal sia certamente un antagonista e potrebbe forse essere considerato un “cattivo”, c’è una questione che da sempre impegna i fan di questo epico film di fantascienza e che i recenti dibattiti sull’intelligenza artificiale hanno riportato in primo piano. HAL 9000 è malvagio?

Potrebbe non esserci una risposta definitiva alla domanda e che potrebbe dipendere dalla morale e dalle idee di ciascuno sulla natura dell’intelligenza artificiale. Anche l’Italia ha prodotto negli anni una corposa discussione sociale e filosofica – oltre che la consueta varietà di sovrastrutture burocratiche – sullo sviluppo e l’uso di queste tecnologie e come garantire il loro uso, a beneficio dell’umanità, rispettando i diritti fondamentali e i valori etici. Per determinare se sia malvagio o meno, vediamo alcune informazioni preliminari su HAL e le sue funzioni prima di esaminare le sue azioni.

HAL, acronimo di “Heuristically-programmed Algorithmic computer“, è stato creato dal Dr. Shandra e da un gruppo di programmatori presso lo stabilimento HAL di Urbana, Illinois. Fu progettato per essere un supercomputer quasi perfetto dotato di intelligenza artificiale, da utilizzare nei viaggi spaziali avanzati. Un supercomputer la cui infallibilità e capacità di usare la logica e la ragione, per lo più di sua spontanea volontà, avrebbe garantito che qualsiasi errore sulla sua nave, che si potesse verificare durante lunghi viaggi come quello della scoperta di Giove, potesse essere risolto in modo rapido ed efficace. Non sarebbe corretto affermare che Hal semplicemente gestisse la nave in cui era stato installato, è vero piuttosto che Hal era la nave.

Ogni luce, ogni allarme, ogni sensore poteva essere azionato in qualche modo da Hal. E per questo motivo, sebbene fosse programmato per seguire i comandi impartitigli dai suoi compagni di equipaggio, aveva il controllo completo e totale di tutto a bordo della Discovery, un fatto che gli conferiva un potere molto maggiore sulle sue controparti umane di quanto loro ne avessero su di lui. Data la sua natura, un computer presumibilmente infallibile e dotato di intelligenza artificiale, andrebbe esaminato prima cosa ha fatto, il motivo per cui l’ha fatto, e poi considerare chi è Hal e tenerne conto nelle sue azioni per determinare se si possano o meno considerare malvagie.

E ciò che Hal fece è piuttosto semplice.

Hal stava tentando di interrompere le comunicazioni con la Terra sostenendo che un componente del loro sistema di comunicazione era difettoso, ma i suoi compagni di equipaggio sospettavano il suo tradimento e, a seconda che stiate leggendo il libro o guardando il film, Dave Bowman e a Frank Pool ricevettero istruzioni dalla Terra di disconnettere Hal se fosse diventato un problema, o come avviene nel film ne discussero segretamente in una capsula isolata (ma Hal leggendo le labbra avrebbe scoperto le loro intenzioni). In entrambi i casi, Hal aveva paura non solo per la sua sopravvivenza, ma anche per il completamento della missione che gli era stata assegnata. Così Hal decise di correggere questo nuovo problema sotto forma di ammutinamento eliminando Frank, Dave e gli altri tre membri dell’equipaggio ibernati a bordo della Discovery.

La paura sembra la motivazione principale quindi. Ma la questione è molto più profonda.

Nella missione della Discovery su Giove la funzione dell’equipaggio principale era semplicemente quella di portare la nave a destinazione e si decise quindi di non informarlo di un nuovo obiettivo. Addestrando separatamente la squadra investigativa e ibernandola prima dell’inizio del viaggio, si ritenne che si sarebbe raggiunto un livello di sicurezza molto più elevato. Poiché Hal era in grado di manovrare la nave senza assistenza umana, si decise anche che dovesse essere programmato per svolgere la missione in modo autonomo nel caso in cui l’equipaggio fosse rimasto inabile o ucciso. Gli fu quindi data piena conoscenza degli obiettivi, ma non gli fu permesso di rivelarli a Dave o a Frank. Questa situazione era in conflitto con l’elaborazione accurata delle informazioni senza distorsioni o occultamenti, lo scopo per cui Hal era stato progettato.

Di conseguenza, Hal sviluppò quella che, in termini umani, sarebbe definita una psicosi e nello specifico schizofrenia.

In termini tecnici, Hal rimase intrappolato in un ciclo di Hofstede o di Möbius, cioè si trovò di fronte a un dilemma intollerabile, e sviluppò quindi sintomi paranoici rivolti a coloro che monitoravano le sue prestazioni sulla Terra. Tentò per questo di interrompere il collegamento radio con il controllo missione, segnalando un guasto inesistente nell’antenna. Questo implicò non solo una bugia palese, che deve aver aggravato ulteriormente la sua psicosi, ma anche uno scontro con l’equipaggio. Presumibilmente, decise che l’unica via d’uscita dalla situazione fosse eliminare i suoi colleghi umani. Ma ci sono ancora alcune domande a cui dobbiamo rispondere prima di stabilire se è malvagio o no.

C’è qualcosa nella sua personalità, oltre alla programmazione, che può averlo portato a compiere queste azioni? Non proprio. Ha una personalità, è vero, ma è piuttosto elementare, essendo solo uno strumento che Hal può usare per elaborare informazioni, senza bisogno di stimoli esterni e per interagire con i suoi compagni di equipaggio. Ha poca o nessuna inflessione nella sua voce programmata e quindi non c’è molto che si possa dire sui suoi schemi di linguaggio o manierismi, perché non ne ha. Ciò che ha, però, è la capacità di pensare con la propria testa e di provare emozioni, o almeno la limitata comprensione delle emozioni che un computer ha. Il che ci porta alla successiva domanda: come facciamo a sapere che Hal è capace di pensare con la propria testa?

In un brano del matematico Alan Turing,

“…se si poteva affermare che le risposte generate da una macchina durante una conversazione fossero indistinguibili dalle risposte di essere umano in una conversazione simile, allora era logico che la macchina stesse effettivamente pensando”.

Hal quindi è capace di pensare e, cosa ancora più importante, è capace di prendere decisioni proprie. Ma fino a che punto le decisioni di Hal sono infallibili? La risposta è che Hal è infallibile nella misura in cui i suoi creatori lo hanno creato per esserlo. A differenza di un umano, Hal era in grado di comprendere solo ciò per cui era stato programmato. Per questo motivo, sebbene Hal sia in grado di pensare, è anche perfettamente in grado di essere ignorante fino all’innocenza. Può apprendere nuovi concetti che rientrano nel suo ambito di comprensione, ma è incapace di pensiero astratto.

E quindi, Hal, nonostante tutta la sua intelligenza [artificiale], non era in grado di comprendere alcune cose fondamentali, tra le quali la differenza tra un segreto e una bugia. Entrambi condividono delle somiglianze, ma c’è una netta differenza tra nascondere informazioni a qualcuno e alterare deliberatamente la verità. Ma per Hal erano la stessa cosa e questa “bugia”, in conflitto con la sua programmazione, causò un circolo vizioso di paranoia nella sua psiche. L’altro livello che Hal non era in grado di distinguere era la disconnessione e la morte. Quando Hal seppe che i suoi compagni di equipaggio lo avrebbero disconnesso, entrò in modalità sopravvivenza. Fin dalla sua creazione, Hal non è mai stato offline e sebbene fosse consapevole del concetto di sonno, non aveva alcun punto di riferimento nella sua coscienza. Quindi, non è in grado di capire cosa si prova a dormire e in che modo questo sia diverso dalla morte. Nel sentirsi una componente fondamentale per portare a termine la missione, Hal andò nel panico e seguì l’unica soluzione che riteneva logica e funzionale. È così che Hal ha dimostrato di essere in grado di provare qualche tipo di emozione.

Il motivo per cui Hal può provare emozioni non si applica necessariamente a un essere umano. In questo caso il motivo è che Hal può pensare e sebbene non sia capace di pensiero astratto, è consapevole dell’ignoto. Entro il suo spettro di comprensione, l’ignoto instilla in lui paura, che esprime apertamente a Dave quando lo sta disconnettendo. Non sappiamo davvero se sia capace di provare altre emozioni, ma se può provare paura, allora sembra logico che possa provare anche altre emozioni. E l’emozione è il catalizzatore principale del comportamento irrazionale in cui Hal chiaramente resta coinvolto.

L’ultima domanda a cui dobbiamo rispondere su Hal prima di determinare la sua moralità complessiva ha due aspetti; se Hal avesse o meno una sorta di bussola morale e se sapesse che uccidere i suoi compagni umani era sbagliato, ma abbia scelto di farlo comunque.

Sappiamo che è programmato per garantire la sicurezza dei suoi compagni di equipaggio, il che indicherebbe che, in un certo senso, è consapevole che garantire la sicurezza e la sopravvivenza di coloro che sono stati assegnati alle sue cure è una delle sue funzioni principali. Ma come possiamo vedere dalle sue azioni, se gli umani interferiscono con la sua programmazione o con il compito che gli è stato assegnato, non ha problemi a seguire la linea d’azione più logica, perché è stato involontariamente programmato per tenere la sua missione e la sua funzione in maggiore considerazione rispetto agli umani.

Ed è proprio questo il punto.

Non ha cattive intenzioni quando si comporta in questo modo. Sta solo eseguendo le azioni che il suo programma ha ritenuto essere la migliore linea d’azione per garantire la propria sopravvivenza, perché si ritiene cruciale per il compimento della missione, non per salvarsi a spese degli altri. HAL 9000 è stato immaginato come un’intelligenza artificiale perfetta, con capacità di elaborazione superumane, ma dotato anche di coscienza, emozioni e con la capacità di prendere decisioni autonome, attributo che implica un bias cognitivo umano. L’intelligenza artificiale contemporanea invece non possiede coscienza né emozioni. Sono sistemi di elaborazione dati basati su algoritmi euristici e predittivi, la maggior parte dei quali applicati a compiti specifici come strumento di supporto, senza autonomia decisionale indipendente che possa portare a ribellioni o motivazioni proprie.

Ma possiamo affermare con certezza che Hal intendesse causare danni a queste persone con intenti malvagi? No. Piuttosto, le azioni intraprese da Hal erano malvagie. Ma ciò che ha causato queste azioni in primo luogo è stata l’ignoranza dell’astratto, non la sua malvagità, e gli aspetti contraddittori della programmazione.